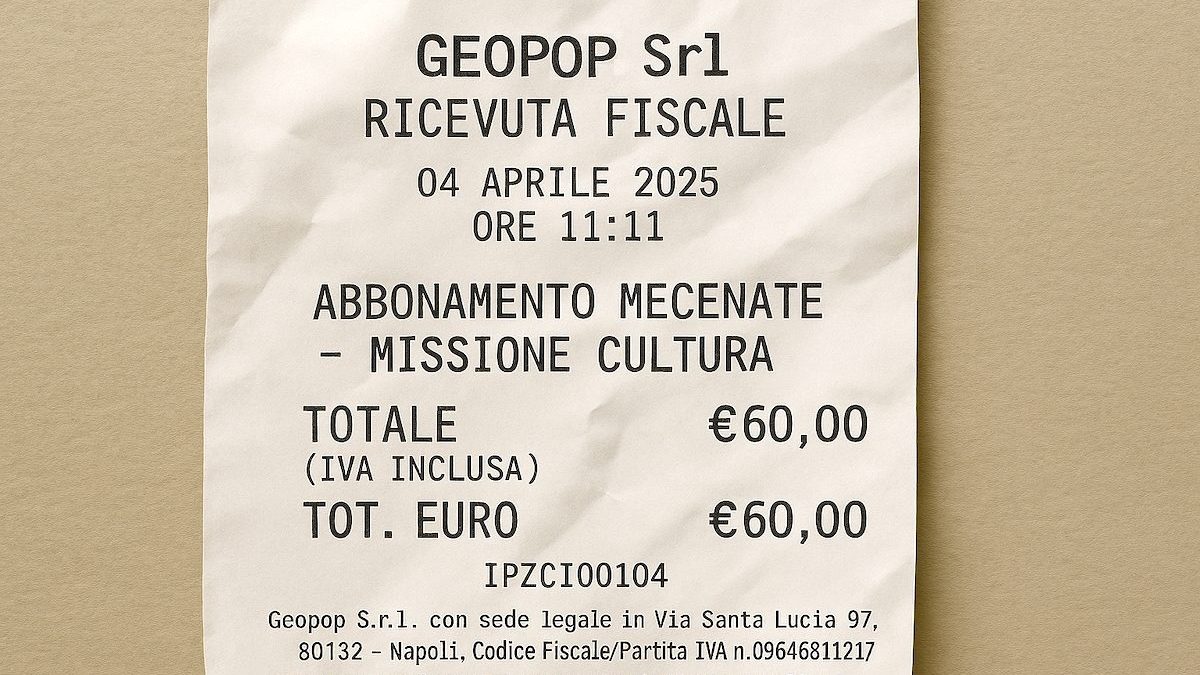

L'intelligenza artificiale generativa ha compiuto un altro balzo in avanti importante, grazie al nuovo generatore di immagini basato sul modello GPT-4o di OpenAI, già disponibile per tutti su ChatGPT, compresi gli utenti che hanno l'account free. E la novità questa volta potrebbe avere un impatto sulle tasche dei consumatori e dei sistemi antifrode delle aziende. ChatGPT, essendo ora in grado di creare grafiche estremamente realistiche, compresi testi leggibili e coerenti, sta destando non poche preoccupazioni, dopo l'utilizzo improprio delle immagini in stile “Studio Ghibli” di Miyazaki, per la possibilità che dà di generare ricevute false con l'AI. Questo significa che, a tutti gli effetti, è possibile chiedere a un modello di AI di creare una ricevuta fittizia per un ristorante, un negozio o una qualsiasi attività commerciale. E non si tratta di semplici esempi astratti: online stanno già circolando scontrini verosimili generati con questa tecnologia, in alcuni casi addirittura "sporcati" digitalmente con macchie di cibo o piegature per sembrare usati. Il rischio è chiaro: sebbene lo strumento sia stato pensato per scopi creativi e didattici, diventa estremamente facile abusarne per mettere in atto frodi, ad esempio gonfiando rimborsi spese o presentando prove false in contesti legali o assicurativi.

Le nuove capacità del modello GPT-4o

La novità principale riguarda la capacità del nuovo modello 4o di generare testo perfettamente leggibile all'interno delle immagini, un ostacolo tecnico che fino a poco tempo fa rappresentava un limite per l'AI generativa e che consentiva di distinguere le immagini generate artificialmente dalle immagini reali con molta più facilità rispetto a ora. Ecco che produrre immagini di scontrini dove cifre, nomi e dettagli grafici appaiono nitidi e credibili non è più niente di utopico. Alcuni utenti sui social media, tra cui l'account X @deedydas, hanno condiviso esempi impressionanti: ricevute di ristoranti reali, modificate digitalmente con nomi plausibili, prezzi coerenti e un aspetto visivo quasi totalmente indistinguibile da un documento autentico. In certi casi, per aumentarne la credibilità, sono stati aggiunti elementi di “disturbo” come macchie o pieghe.

È importante sapere che i modelli di linguaggio di grandi dimensioni, i cosiddetti LLM (Large Language Models) come GPT-4o non sono ancora perfetti in ambito numerico: spesso gli importi non tornano, o i simboli monetari non sono quelli corretti. Ma questi piccoli errori possono essere facilmente corretti con un semplice software di fotoritocco oppure fornendo istruzioni più dettagliate al modello. Questo rende lo strumento molto appetibile per chi volesse falsificare prove documentali in modo rapido ed economico.

La risposta di OpenAI

Stando a quanto dichiarato da OpenAI, tutte le immagini generate da ChatGPT includono metadati C2PA, uno standard sviluppato per indicare se un contenuto è stato creato da un'intelligenza artificiale o no. Taya Christianson, portavoce di OpenAI, interpellata da TechRadar, a questo riguardo ha spiegato:

Monitoriamo le generazioni di immagini dentro e fuori dalla nostra piattaforma, utilizziamo strumenti interni per verificare che siano stati creati dai nostri prodotti e agiamo quando identifichiamo le violazioni delle nostre politiche di utilizzo. "Impariamo sempre dall'uso e dal feedback del mondo reale e continueremo a perfezionare le nostre politiche per bilanciare la libertà creativa con la prevenzione dell'uso improprio. Tutte le immagini includono metadati C2PA standard del settore che indicano che sono stati generati dall'IA da OpenAI.

Peccato che i metadati a cui fa riferimento la portavoce di OpenAI possano essere potenzialmente rimossi in una manciata di click durante l'esportazione dell'immagine, rendendo difficile, nella pratica, distinguere una ricevuta falsa da una reale.

Il sito d'informazione tecnologica TechCrunch, nel chiedere a OpenAI perché vengano consentita la generazione di simili contenuti fake, ha ricevuto come risposta che «[l'obiettivo] di OpenAI è quello di offrire agli utenti quanta più libertà creativa possibile» e che le false ricevute generate dall'AI potrebbero essere utilizzate per «insegnare alle persone l'alfabetizzazione finanziaria». A voi il giudizio su queste dichiarazioni.

;Resize,width=767;)

;Resize,width=767;)

;Resize,width=727;)

;Resize,width=727;)

;Resize,width=727;)

;Resize,width=727;)

;Resize,width=727;)