Riuscire a distinguere un video reale da uno generato dall'intelligenza artificiale sta diventando una sfida sempre più complessa. Negli ultimi anni i cosiddetti deepfake, ovvero quei contenuti sintetici che imitano persone, voci e situazioni reali, hanno raggiunto livelli di realismo tali da ingannare potenzialmente chiunque. Oggi strumenti di generazione video basati su modelli di apprendimento automatico consentono anche a chi ha poche competenze tecniche avanzate di creare filmati convincenti. Di conseguenza, sui social circolano sempre più spesso video artificiali: possono essere clip divertenti con animali immaginari, ma anche falsi discorsi di celebrità e personaggi pubblici o, ancora, presunte registrazioni di eventi mai accaduti, dei veri e propri falsi storici creati ad arte per generare disinformazione. In questo approfondimento cercheremo di snocciolare alcuni consigli pratici per provare a riconoscere video generati con l'AI. Parliamo di “provare” perché i video generati con l’AI hanno raggiunto un livello di realismo tale che non sempre è possibile stabilire con piena certezza la natura del filmato che passando sotto la nostra lente.

Cosa sono i deepfake e perché è sempre più difficile riconoscerli

Per comprendere come orientarci in questo scenario dobbiamo prima capire di cosa stiamo parlando. Con il termine deepfake, fusione delle parole inglesi deep learning (una tecnica avanzata di apprendimento automatico) e fake, cioè falso, si indicano video, immagini o audio generati tramite algoritmi che imitano l’aspetto o la voce di una persona reale. Questi sistemi analizzano grandi quantità di dati per riprodurre movimenti facciali, espressioni e timbro vocale con grande precisione.

Mentre fino a uno o due anni fa era molto più semplice individuare la natura artificiale di questi video, oggi le cose stanno diversamente. La tecnologia sta migliorando molto rapidamente. E i modelli più recenti sono in grado di creare video ad alta definizione con movimenti credibili, illuminazione realistica e audio perfettamente sincronizzato. Strumenti come Sora 2, sviluppato da OpenAI, o Veo 3, progettato da Google, rappresentano esempi emblematici di questa evoluzione: producono clip con qualità visiva elevata e scene coerenti dal punto di vista narrativo. Alcuni includono funzioni (come “Cameo” di Sora 2) che permettono di utilizzare le sembianze di altre persone andandole a inserirle in quasi tutte le scene generate dall'AI.

3 suggerimenti pratici per riconoscere video fatti con l’AI

Ora che è un po' più chiaro cos'è un video deepfake e come viene generato, vediamo 3 suggerimenti per riconoscere deepfake fatti con l'AI.

Individuare la presenza di una filigrana

Un primo indizio utile può essere la presenza di una filigrana, cioè un segno grafico applicato automaticamente al contenuto. Alcune piattaforme inseriscono un logo o un simbolo per indicare che il video è stato creato con strumenti di intelligenza artificiale. Nel caso dei contenuti prodotti con Sora, ad esempio, i video scaricati dall’app includono un’icona a forma di “nuvoletta” che si muove lungo i bordi dell’immagine. Si tratta di una sorta di etichetta visiva che segnala l’origine del contenuto. Attenzione però: non è una garanzia assoluta. Se la filigrana è statica può essere ritagliata e rimossa, ed esistono software capaci di rimuovere in una manciata di click anche quelle animate (come quella di Sora). Per questo motivo, la mancanza della filigrana, non necessariamente indica che il video che stiamo guardando è autentico.

Analizzare i metadati dei file

Un metodo più tecnico consiste nell'analizzare i metadati del file. Con questa parola indichiamo tutta una serie di informazioni che accompagnano automaticamente un contenuto digitale quando viene creato. I metadati possono includere il tipo di dispositivo utilizzato, la data e l’ora di registrazione, la posizione geografica o il software che ha generato il file. Alcuni video creati con modelli di intelligenza artificiale contengono indicatori specifici che rivelano la loro origine. Per esempio, Google “marca” i contenuti generati con i suoi modelli AI con il sistema SynthID. Per quanto riguarda i video generati con Sora 2, invece, questi sono contrassegnati dai metadati C2PA, dal momento che OpenAI (la società che sviluppa Sora) fa parte della Coalition for Content Provenance and Authenticity. Ecco una mini-guida su come verificare in entrambi i casi i metadati.

- Visitate questa pagina del sito ContentAuthenticity.

- Caricate il file che desiderate verificare cliccando su Seleziona un file dal dispositivo oppure trascinandolo nel box tratteggiato.

- Controllate le informazioni nel pannello di destra. Se il contenuto è generato dall'AI, sulla destra dovreste vedere un riepilogo simile a quello che vedete nel seguente screenshot d'esempio.

In alternativa, potreste caricare il video su Gemini e chiedere all'AI di Google se il filmato contiene i metadati SynthID.

È bene tenere a mente un fatto comunque: questi strumenti di AI-detecting non sono infallibili. Ciò vuol dire che anche un video generato con l'AI potrebbe non essere contrassegnato come tale da questi rilevatori di metadati.

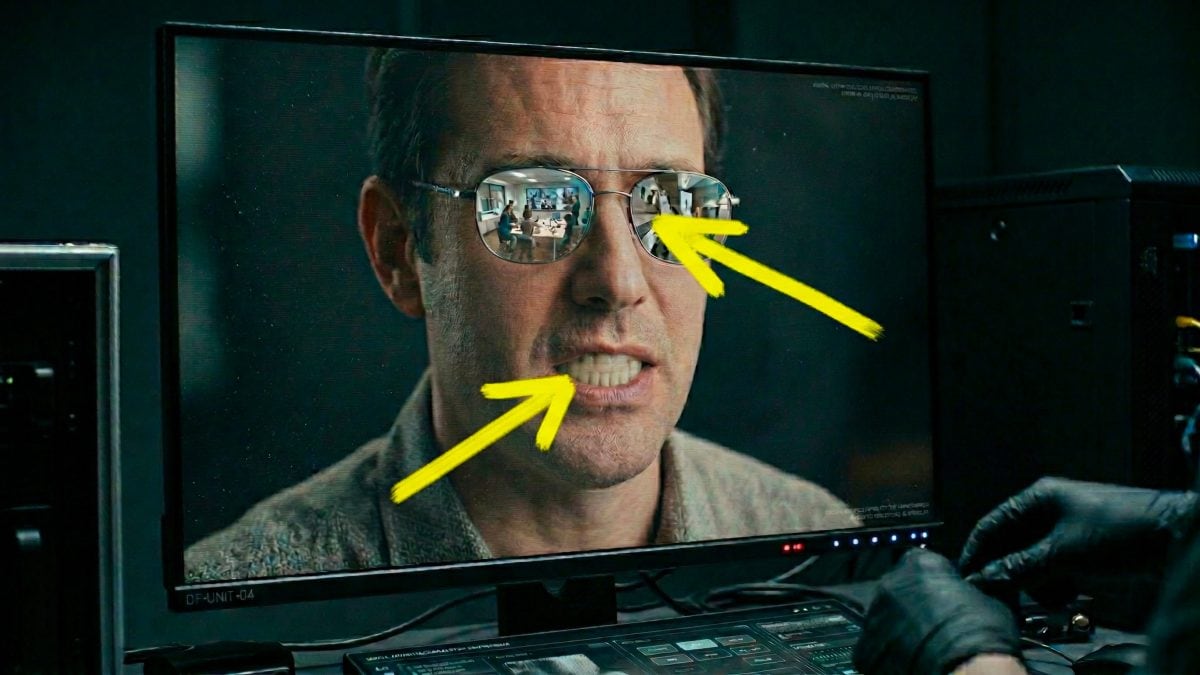

Effettuare un'analisi critica del video

Accanto a strumenti tecnici come quelli menzionati poc’anzi, possiamo affidarci anche all'osservazione critica del video. Nei deepfake più sofisticati può non essere semplice individuare indizi che tradiscono la natura artificiale del contenuto, ma se il video risulta imperfetto e presenta qualche micro-difetto, individuarlo può aiutare ad alimentare eventuali sospetti. Ecco 7 indizi che dovreste provare a individuare:

- Illuminazione o ombre poco realistiche.

- Pelle eccessivamente liscia.

- Denti o occhi leggermente deformati.

- Riflessi innaturali sugli occhiali.

- Battito delle ciglia irregolare.

- Espressioni emotive rigide o “piatte”.

- Audio non perfettamente sincronizzato con il movimento delle labbra.

Naturalmente questi segnali non sono sempre evidenti, soprattutto nei video generati con le tecnologie più evolute. Per questo conviene integrare l'analisi visiva con l'analisi dei metadati (come già detto prima) e anche con una verifica dei fatti e delle eventuali dichiarazioni presentate nel video che è oggetto dell'analisi. Tanto per fare un esempio, se il video mostra un politico che fa certe affermazioni, cercare su Google le frasi esatte che ha pronunciato può consentire di trovare o meno dei riscontri, che possono dare ulteriori indizi sull'origine del contenuto. Questo processo di verifica, tipico del lavoro giornalistico, resta uno degli strumenti più efficaci anche per gli utenti “comuni”.

;Resize,width=767;)

;Resize,width=578;)

;Resize,width=767;)

;Resize,width=727;)

;Resize,width=727;)

;Resize,width=727;)

;Resize,width=727;)

;Resize,width=727;)