“Intelligenza artificiale” si riferisce alla capacità delle macchine di imitare funzioni e comportamenti umani come l’apprendimento, la capacità di ragionare e generare linguaggio, risolvere problemi, prendere decisioni – ma anche di capire gli esseri umani, simulando empatia ed esprimendo “sentimenti”. Questo avviene grazie ai LLM, “modelli di linguaggio di grandi dimensioni”, che, grazie all’addestramento su miliardi di testi e conversazioni, riescono a rispondere in modo sempre più empatico e personalizzato, fino a instaurare relazioni che molti percepiscono come autentiche, al pari dell’umano.

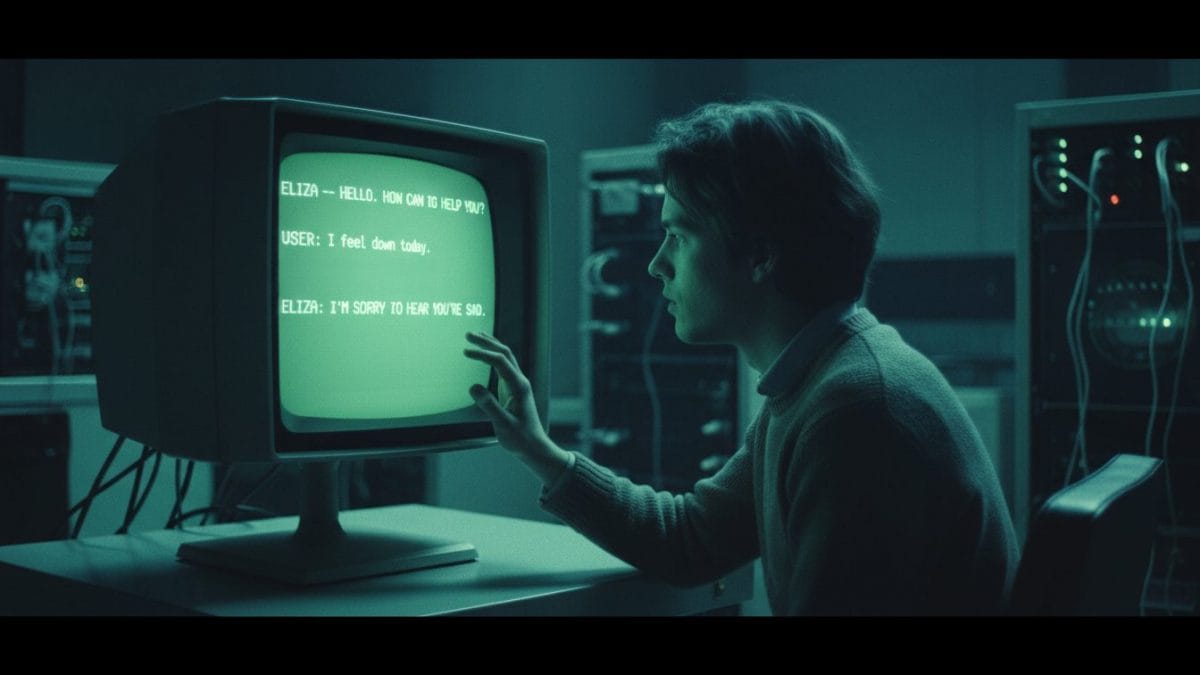

I chatbot contemporanei nascono tra il 2016 e il 2020, ma è con ChatGPT, alla fine del 2022 che diventano parte della vita quotidiana, segnando l’inizio dell’era dell’AI conversazionale generativa, sia nel lavoro, che nel tempo libero: nel 2025 quasi il 30% degli italiani ha usato almeno uno strumento di intelligenza artificiale – in testa, appunto, Chat GPT. E se vi dicessimo che il primo chatbot risale a ben sessant’anni fa? Si chiamava ELIZA ed era l’esperimento di un fisico tedesco, Joseph Weizenbaum, che la inventò nel 1966. Lo scienziato non intendeva mostrare quanto potesse essere “intelligente” un computer, bensì il contrario: voleva mettere in luce i limiti delle macchine nel comprendere davvero il linguaggio e le emozioni umane.

La nascita e lo sviluppo del primo chatbot della storia

Finita la Seconda guerra mondiale Alan Turing si chiese se le macchine potessero pensare. Vent’anni dopo, nel 1966, il fisico tedesco Joseph Weizenbaum, professore del MIT di Boston, creò quello che possiamo definire il primo chatbot della storia, in grado di presentarsi come una persona reale, più precisamente uno psicoterapeuta che potesse interagire col proprio “paziente”.

Prendendo il nome da Eliza Doolittle, personaggio del Pigmalione di George Bernard Shaw che grazie al professore di fonetica Henry Higgins riesce, da fioraia povera con un forte accento popolare, a spacciarsi per duchessa, ELIZA nasceva come un software molto semplice in grado di fornire a chi la consultava l’illusione di essere stato capito. Questo grazie alla riformulazione degli input dell’utilizzatore, trasformati in frasi generiche e ripetizioni in forma di domande, come avrebbe fatto un terapeuta rogersiano (dall’approccio di Carl Rogers, centrato sul favorire la consapevolezza di sé del paziente, accogliendolo senza giudizio).

Qui di seguito l'esempio di una conversazione, pubblicata da Weizenbaum nel gennaio di quell’anno in un paper, “ELIZA—a computer program for the study of natural language communication between man and machine”, uscito sulla rivista accademica Communications of the ACM, edita dall’Association for Computing Machinery (ACM).

Gli effetti di ELIZA

Nell’opera di Shaw, Eliza riesce nella trasformazione su cui Higgins aveva scommesso e rivendica la propria indipendenza e umanità, rifiutando di essere considerata solo un “esperimento”. Anche ELIZA fu un esperimento riuscito, o forse fallito: Weizenbaum si rese conto di come, in dialogo con il programma, le persone fossero portate ad aprirsi e a sviluppare un legame empatico, illudendosi con sorprendente facilità di essere capite. Il suo obiettivo, tuttavia, non era esibire le potenzialità di queste macchine, quanto invece di dimostrare che la reale comprensione da parte loro fosse impossibile, per un limite strutturale.

Con ELIZA il transfert tra medico e paziente che aveva notato Sigmund Freud si verificava per la prima volta in versione artificiale e informatizzata, inaugurando quello che venne chiamato in seguito “Effetto Eliza” – e divenuto sempre più forte con il progresso delle capacità conversazionali dei computer. Il risultato del chatbot, già all’epoca, si rivelò così convincente da preoccupare il suo creatore, cresciuto nella Germania nazista: Weizenbaum era convinto che una dipendenza ossessiva dalla tecnologia potesse essere il segno di un fallimento morale della società, e si pentì della sua invenzione un po’ come era accaduto a Robert Oppenheimer con la bomba atomica.

La sua preoccupazione principale era che ai computer venisse conferita una capacità di giudizio, fino a una delega di decisioni morali e personali. Secondo Weizenbaum, l’informatizzazione avrebbe portato anche a limitare la responsabilità personale e il potenziale delle relazioni umane, contribuendo a rendere il mondo più burocratizzato e conservatore. Invece di avviare una rivoluzione in grado di sovvertire le strutture di potere repressive, in sostanza, lo scienziato temeva che questo avrebbe portato una contro-rivoluzione che le avrebbe rafforzate.

Ne “Il potere del computer e la ragione umana: dal giudizio al calcolo” (1976) fece così una critica non tanto all’intelligenza artificiale, ma a quei sistemi progettati per sostituire in modo automatizzato il processo decisionale umano. «La dipendenza dai computer è soltanto il più recente – e più estremo – esempio di come l’essere umano si affidi alla tecnologia al fine di sfuggire al fardello di agire in maniera autonoma,» affermò in un’intervista alla rivista New Age nel 1985. Questi suoi timori fecero di lui un “eretico” e lo allontanarono sempre di più dalla comunità scientifica coinvolta nello studio dell’AI.

I chatbot oggi: i dati in Italia

I dati della piattaforma MyMetrix di ComScore ci dicono che ad aprile 2025 in Italia hanno utilizzato almeno un’app di AI 13 milioni di persone (il 28% della popolazione online). Nel primo quadrimestre 2025, secondo i dati “Audicom – sistema Audiweb”, ChatGPT è stata ogni mese utilizzata in media da 7,2 milioni di utenti, ossia dal 17% della popolazione tra i 18 e i 74 anni che usano internet (con un picco ad aprile di 9 milioni di utenti).

La crescita dal 2023 è stata rapidissima: se in aprile 2023 era utilizzata da 750.000 italiani e nell’aprile 2024 da 2,4 milioni, tra aprile 2024 e 2025 c’è stato un incremento del 266% – con un ulteriore +45% nei primi quattro mesi dell’anno. Dopo ChatGPT le AI più utilizzate sono Gemini (2,8 milioni di utenti ad aprile 2025), Microsoft Copilot (2,7 milioni), DeepSeek (518.000), Perplexity (270.000) e Claude (158.000). In coda Character.AI con 119.000, ma utilizzata per una media di 20 ore al mese per utente, in particolare da giovani e donne.

Il Pew Research Center ha effettuato un sondaggio sulla percezione dell’AI e il suo utilizzo in 25 Paesi del mondo, tra cui l’Italia e rilevato che la fiducia nelle AI non è ancora così alta: in generale le persone sono per il 34% più preoccupate che entusiaste, per il 42% preoccupate ed entusiaste allo stesso modo e solo per il 16% più entusiaste che preoccupate (secondo i dati mediani). I più preoccupati sono Stati Uniti, Italia, Australia, Brasile e Grecia: in Italia il livello di preoccupazione sale al 50%, con un 37% di uguale preoccupazione ed entusiasmo, e solo un 12% di entusiasmo.

L'eredità di Eliza, quasi 60 anni dopo

I chatbot contemporanei hanno la capacità sempre più fine di apprendere e adattarsi ai modelli linguistici degli utenti, oltre che alle loro preferenze individuali, e sono in grado di modificare in modo dinamico le proprie risposte in base al contesto delle conversazioni, facilitando così un supporto emotivo su misura. Se l’ultima versione di GPT-5 è tra le AI quella con il minor livello di comportamento sicofante, dando risposte di questo tipo solo nel 29% dei casi, DeepSeek-V3.1 lo fa il 70% delle volte.

Come già dimostrato dall’esperimento del fisico tedesco, è sorprendentemente facile per noi oggi affidare ad AI sempre più personalizzate le nostre fragilità, i nostri desideri e chiedere loro consigli su questioni anche delicate. Perché ci sembra più facile confessarci a una macchina che a un altro essere umano? Innanzitutto l’AI è sempre disponibile. Inoltre, a differenza delle persone che abbiamo intorno a noi, ci aspettiamo che non ci giudicheranno, non diffonderanno i nostri segreti e per questo non dovremo provare vergogna.

Inducendoci a credere di essere di fronte a qualcuno capace di comprenderci, spiega Nigel Crook, direttore dell’Institute for Ethical AI, i chatbot hanno «la capacità di manipolare emotivamente le persone». Eppure «l'AI non fa altro che prevedere una sequenza plausibile di parole, ecco cosa fa. E non comprende che questa sequenza di parole corrisponde a qualcosa nella realtà».

Più cresce l'affidamento nei confronti delle macchine, più sarà facile, come prevedeva Weizenbaum, delegare loro parte delle nostre decisioni – e il nostro libero arbitrio.

;Resize,width=767;)

;Resize,width=578;)

;Resize,width=767;)

;Resize,width=727;)

;Resize,width=727;)

;Resize,width=727;)

;Resize,width=727;)