Le sintesi generate dall'intelligenza artificiale di Google, le cosiddette AI Overview, ovvero quei blocchi di testo che appaiono solitamente in cima ai risultati di ricerca e che riassumono automaticamente la risposta a una domanda, rispondono correttamente circa al 91% delle domande fattuali. Sembra un risultato apparentemente eccellente, ma nasconde un problema di scala gigantesco. Secondo alcune stime, su Google vengono prodotte qualcosa come più di 5.000 miliardi di ricerche all'anno. Non sono bruscolini. Se il 10% circa di queste ricerche restituiscono riassunti AI errati, vuol dire che ogni ora decine di milioni di risposte potrebbero restituire informazioni errate. È un dato tutt'altro che eccellente.

A fotografare questa situazione è un'analisi condotta dal New York Times in collaborazione con Oumi, una startup specializzata in intelligenza artificiale, che ha messo alla prova il sistema di Google su migliaia di domande concrete. I risultati mostrano un lieve miglioramento nell'accuratezza delle risposte date, ma al tempo stesso anche una nuova criticità: le fonti citate dalle AI Overview sono sempre meno affidabili, rendendo più difficile per gli utenti verificare in autonomia le informazioni ricevute.

AI Overview messo alla prova

Il metodo usato da Oumi per testare le AI Overview si chiama SimpleQA. Si tratta di un benchmark – cioè uno strumento standardizzato di valutazione – sviluppato da OpenAI e ampiamente usato nel settore per misurare l'accuratezza fattuale dei sistemi di intelligenza artificiale. Su un campione di 4.326 ricerche, i risultati hanno mostrato un'evoluzione significativa: con Gemini 2 (il modello in uso a ottobre 2024), le risposte corrette si fermavano all'85%. Con l'aggiornamento a Gemini 3 (testato a febbraio 2025) la percentuale è salita al 91%.

Il vero problema, però, non è tanto la risposta in sé quanto le fonti che la accompagnano. Oumi ha rilevato che una parte consistente delle risposte corrette rilevate a febbraio erano “prive di fondamento”. In altre parole, i link citati a supporto della risposta non confermavano effettivamente quanto affermato. A ottobre questa percentuale era già preoccupante, toccava quota 37%, ma a febbraio è salita al 56%. In pratica, Google fornisce in buona parte dei casi una risposta giusta, ma le pagine a cui rimanda non la spiegano, non la confermano o addirittura la contraddicono, e questo per oltre metà dei casi. Tra le fonti più citate dai riepiloghi di Gemini figurano Facebook e Reddit, piattaforme che non garantiscono certo la stessa affidabilità di una fonte giornalistica o scientifica.

Il New York Times ha documentato alcuni degli errori più eclatanti commessi durante lo studio. Alla domanda su quando la casa di Bob Marley fosse diventata un museo, Google ha risposto “1987” invece del corretto “1986”, con fonti che non confermavano la data indicata. In una ricerca su Yo-Yo Ma e la Classical Music Hall of Fame, il motore ha rimandato al sito ufficiale dell'organizzazione sostenendo però che il musicista non ne facesse parte. In un altro caso, l'età di Dick Drago al momento della morte era corretta, ma la data del decesso era sbagliata. Casi isolati, certo, ma emblematici di un pattern ricorrente.

Ancora più rilevante è un esperimento condotto da un giornalista della BBC, che ha creato appositamente un articolo con informazioni volutamente false e lo ha pubblicato online. In meno di 24 ore, il sistema di riepilogo di Google aveva già assorbito e riprodotto quelle notizie errate nelle sue AI Overview. Questo fenomeno, noto come “avvelenamento dei dati” (o data poisoning), mostra quanto i sistemi di sintesi automatica siano vulnerabili a contenuti inaffidabili o manipolati.

La “doppia” risposta di Google

La risposta di Google in merito ai problemi riscontrati dallo studio che abbiamo appena menzionato non ha tardato ad arrivare. Il colosso delle ricerche online ha contestato sia la metodologia che le conclusioni dello studio. Il portavoce Ned Adriance ha definito il rapporto pieno di «gravi lacune», sottolineando che SimpleQA è un benchmark sviluppato da un concorrente diretto, appunto OpenAI (l’azienda che sviluppa ChatGPT), e che contiene a sua volta alcune imprecisioni.

Google ha anche fatto notare che Oumi ha usato sistemi di intelligenza artificiale propri per analizzare i riepiloghi generati dall'IA di Google, introducendo un potenziale ulteriore margine di errore. Argomentazioni non del tutto prive di fondamento, ma che rischiano di suonare paradossali: sostenere che uno studio sull'imprecisione dell'AI sia stato condotto con strumenti anch'essi imprecisi non rafforza certo la fiducia nel prodotto che si sta difendendo.

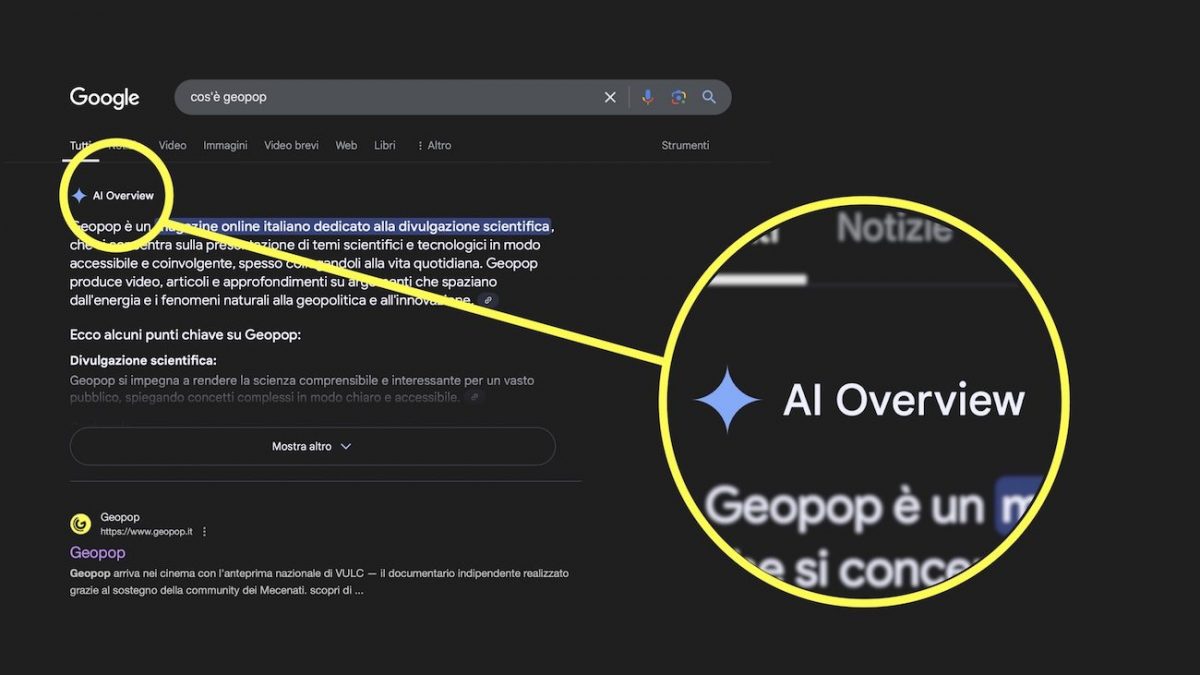

A proposito di questo, ci siamo chiesti se la risposta “ufficiale” data da Google corrisponda alla risposta generata dalla sua AI Overview. E sapete cosa abbiamo scoperto? Chiedendo a Google «Quanto sono accurate le risposte dell'AI Overview», questo è la risposta che ci è stata data.

Come avete appena notato, la stessa AI Overview di Google ammette di essere accurata nel 90% dei casi, confermando quindi la percentuale che esce fuori dallo studio condotto dal New York Times in collaborazione con Oumi. Questo è paradossale: se lo studio in questione dovesse effettivamente risultare impreciso, allora anche la risposta data dall’AI Overview di Google lo sarebbe dimostrando la sua influenzabilità data dalle fonti a cui accede sul Web.

;Resize,width=767;)

;Resize,width=578;)

;Resize,width=767;)

;Resize,width=727;)

;Resize,width=727;)

;Resize,width=727;)